宁波材料所在姿态估计研究方面取得进展

试图让计算机具备自动理解图像或者视频序列中蕴含的人体行为信息的能力一直都是众多机器学习相关领域研究的热点问题。人体姿态估计是这些任务的重要基础,在行为识别、人机交互、人类重新识别、影音娱乐等领域均有广泛的应用。人体姿势估计是指通过从图像中定位身体关键点(头部、肩部、肘部、手腕、膝盖、脚踝等)来识别姿势的任务。由于自然图片中的背景与光照、人体外观特征和姿势结构的复杂多变性,该任务面临诸多挑战,当场景推广到多人时,问题进一步复杂化。中国科学院宁波材料技术与工程研究所计算机视觉团队基于全局信息整合的姿态估计方面开展了深入的研究。

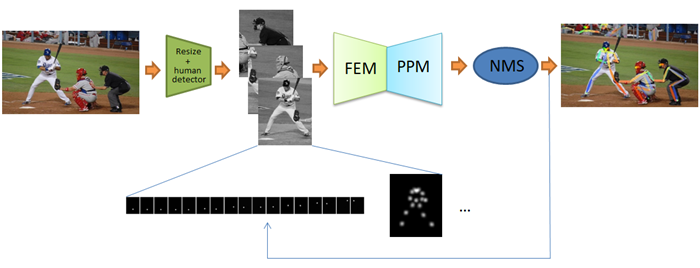

在这项工作中,团队主要关注基于卷积神经网络的方法,采用两步框架实现多人姿态估计。输入一张尺寸为W×H×3的图像,将其大小调整为CNN的输入大小,经过人体检测器生成一组人体边界框,获得的人体边界框被输入“特征编码(FEM)+姿态解码(PPM)”模块,依次预测每个人关键点的定位,生成k个尺寸为W’×H’的热图Mk来表示第k个关键点的位置置信度。最后,执行非极大值抑制来消除冗余姿势,得到最终的人体姿态。

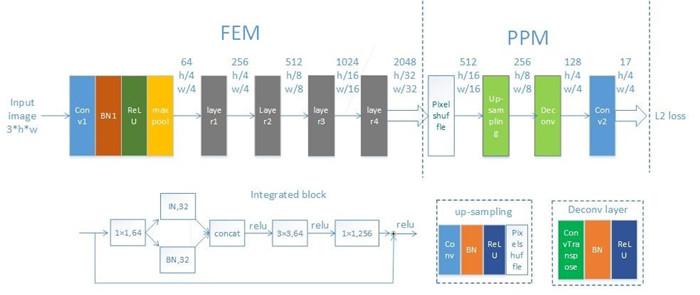

团队在获得了良好的人体边界框提议后,设计了一种基于全局信息提取的新型网络结构,包含特征编码与姿态解码两个部分。基于全局信息整合的图像特征编码模块学习图像中良好的特征,包括特定于实例的对外观不变的信息,如颜色、样式等。团队使用的网络结构基于最常用的图像特征提取骨干网络ResNet,加入FEM子网络,采用与之前网络不同的归一化策略,提取更加详尽的图像特征,以预测更加精准的关键点位置。另外提出了一种新颖的卷积结构FEM,它可以学习捕捉和消除外观变化,同时保持对学习特征的区分。

为了进一步降低人员的错误连接,团队还将人体连接的先验知识加入网络,实现连接精度的提高,设计了一个超边几何约束来模拟人类骨骼结构,旨在提高当前深度网络在建模结构先验中的能力,以进行姿态估计。这种策略改进了复杂或拥挤场景中被遮挡关键点的估计。相关研究工作发表于Journal of Physics Conference, 2019, 1302:032015。

图1 框架概述,通过将一张图片中多个人员实例检测为单人检测框提议,输入特征编码模块(FEM)与姿态解析模块(PPM),FEM接收人类提议,PPM生成姿势提议;经过非极大值抑制(NMS)以消除冗余姿势估计,生成最终的多人姿势提议

图2 FEM和PPM策略的说明,输入RGB图片,通过集成IN与BN构建块的FEM子网络进行下采样提取特征,经过PPM(包含三种不同策略)子网络生成精确地人体关键点热图

图3 人体关键点定位,左边为basenet预测的姿态及关键点热图,右图是采用团队的“FEM+PPM”改进后的结果

图4 COCO验证的精确回忆曲线在所有,大和中等尺度上设置

图5 团队所建立的模型在COCO数据集上预测的一些结果:包含视点和外观变化、遮挡、多个人和常见的成像工件

(先进制造所 杨景翔 许根)